”self-hosted developer-tools time-tracker wakatime wakatime-api coding-statistics Go“ 的搜索结果

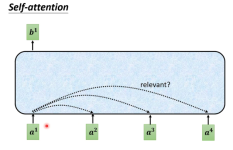

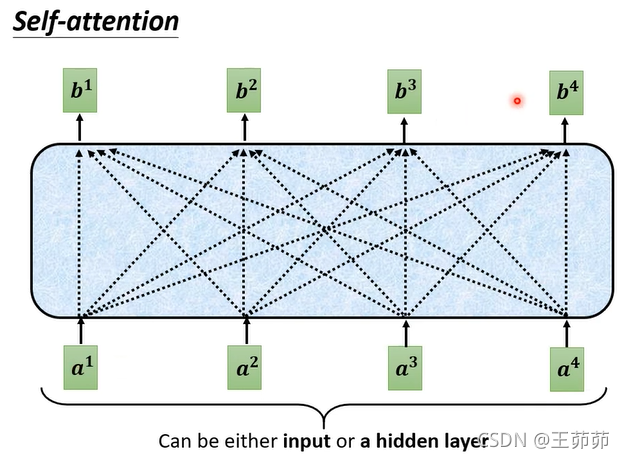

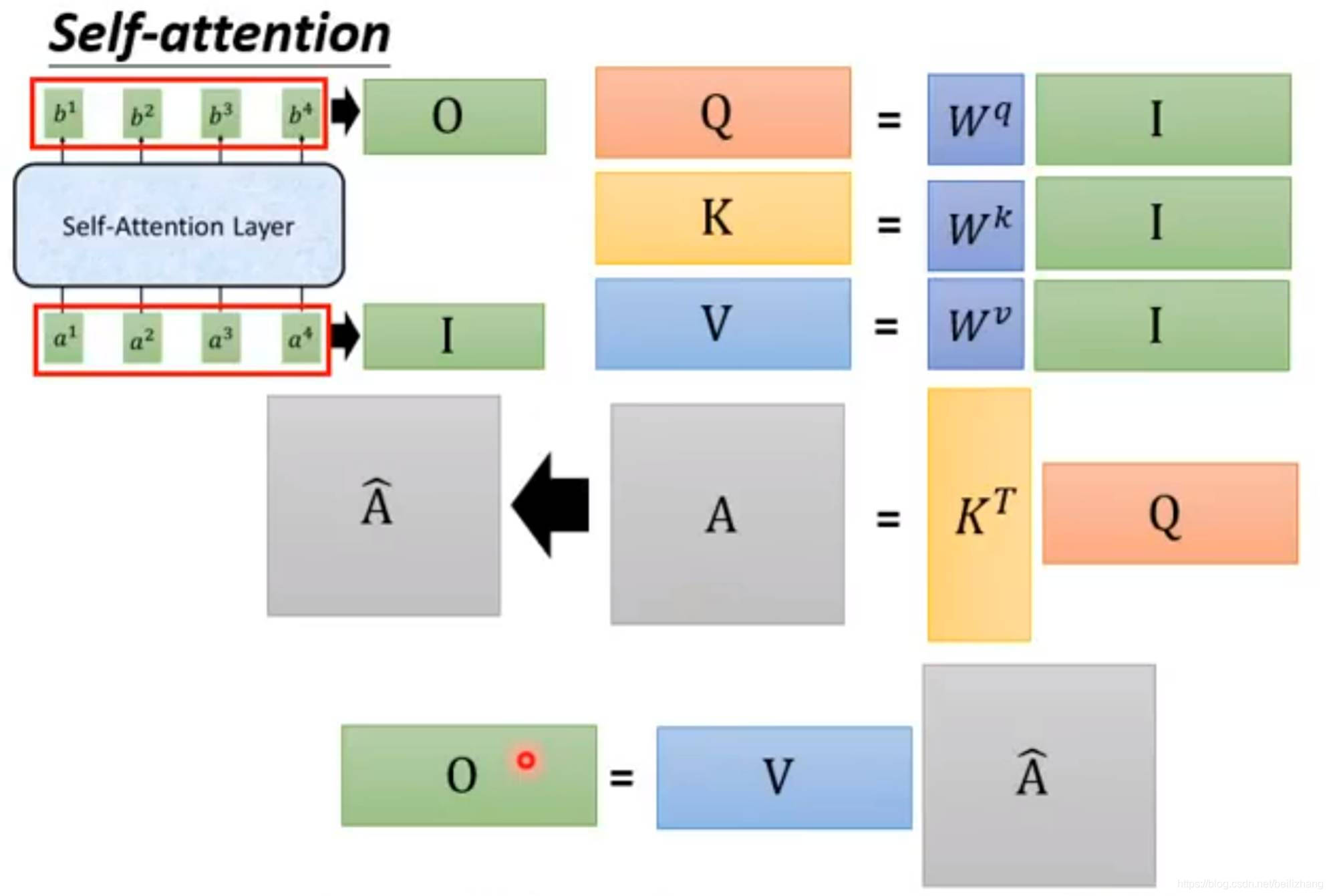

1 Self-Attention的概念2 Self-Attention的原理3 Self-Attention的作用4 Self-Attention的问题。

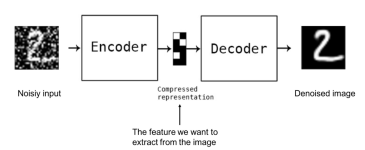

自监督学习用于推荐

自关注与文本分类 本仓库基于自关注机制实现文本分类。 依赖 Python 3.5 凯拉斯 数据集 IMDB影评高度分类数据集,来自IMDB的25,000条影评,被标记为正面/纵向两种评价。影评已被预先为词下标构成的序列。...

Self-Attention Mechanism 论文解析 DANet CCNet ISSA 关于1×1卷积的作用:1×1 卷积 背景 语义分割经历多年的发展,提出了FCN、U-Net、SegNet、DeepLab等一大批优秀的语义分割网络。但是FCN等结构限制了...

self-attention 原理 keras 使用self-attention 安装 pip install keras-self-attention 使用demo import keras from keras_self_attention import SeqSelfAttention model = keras.models....

对于《Attention is all you need》这篇文章中提到的transformer模型,自己最初阅读的时候并不是很理解,于是决定从头开始,一点一点梳理transformer模型。这篇论文主要亮点在于: (1)不同于以往主流机器翻译使用...

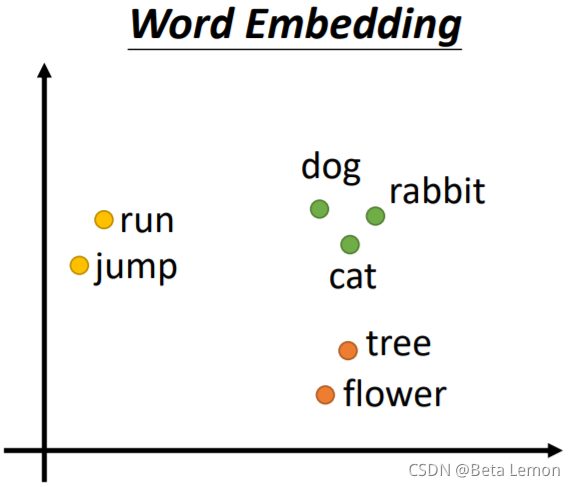

Attention与Self Attention Self Attention也经常被称为intra Attention(内部Attention),最近一年也获得了比较广泛的使用,比如Google最新的机器翻译模型内部大量采用了Self Attention模型。 在一般任务的...

eslint的警告 不能把变量本身赋值给变量 例子: var a = 1; a = a 解决办法:定义多一个变量,赋值给新变量,然后再赋值

推荐文章

- 联邦学习综述-程序员宅基地

- virtuoso--工艺库答疑_tsmc mac-程序员宅基地

- C++中的exit函数_c++ exit-程序员宅基地

- Java入门基础知识点总结(详细篇)_java基础知识重点总结-程序员宅基地

- 【SpringBoot】82、SpringBoot集成Quartz实现动态管理定时任务_springboot集成quratz 实现动态任务调度-程序员宅基地

- testNG常见测试方法_idea_java_testng 测试-程序员宅基地

- Debian11系统安装-程序员宅基地

- Centos7重置root用户密码_centos7更改root密码-程序员宅基地

- STM32常用协议之IIC协议详解_正点原子stm32 iic-程序员宅基地

- 【视频播放】Jplayer视频播放器的使用_jplayer 播放amr-程序员宅基地